OpenClaw 是一款功能强大的 AI 终端工具,通过接入本地运行的 Ollama,可以实现低延迟、零成本、高隐私的 AI 交互体验。本文将详细介绍如何通过命令行交互和 Web 界面方式完成配置。

一、 核心配置逻辑(四点总结)

为了确保配置一次性成功,请牢记以下要点:

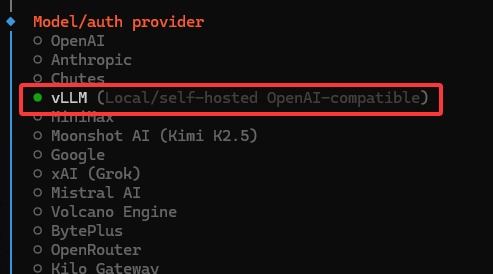

- 协议口径: 虽然使用的是 Ollama,但在配置时建议选择 vLLM 供应商模式。这是因为 Ollama 原生兼容 OpenAI 接口规范,通过 vLLM 协议对接最为稳妥。

- 地址补全:

Base URL是连接的关键。填写的 IP 端口(默认11434)末尾务必带上/v1路径后缀。 - 手动触发机制: 在设置默认模型阶段,必须回车选择

Enter model manually,才能激活自定义模型的输入框。 - 名称完全匹配: 填入的模型名称(如

ollama/gpt-oss:20b)必须与你本地ollama list显示的名称完全一致。

二、 交互式命令行配置流

在终端执行 OpenClaw 配置向导时,请参照以下中文注释进行操作:

shell 通过openclaw onboard进行启动配置界面

openclaw onboard通过Model/auth provider栏目,选择第四个:vLLM (Local/self-hosted OpenAI-compatible) 进行回车,开始配置:

配置界面的配置方法:

◇ Model/auth provider

│ vLLM // [选择供应商]:选择 vLLM 选项 (Ollama 默认兼容 OpenAI 接口规范)

│

◇ vLLM base URL

│ http://192.168.1.59:11434/v1 // [设置 Base URL]:填写 Ollama 服务地址,注意末尾必须带上 /v1

│

◇ vLLM API key

│ kaixinitcom6666 // [设置 API Key]:本地调用不需要 Key,但此处为必填,可随意填写

│

◇ vLLM model

│ ollama/gpt-oss:20b // [指定模型名称]:格式通常为 “ollama/模型名:版本”

│

◇ Model configured ───────────────╮

│ │

│ Default model set to vllm/ollama/gpt-oss:20b │ // [系统提示]:模型供应商信息已成功录入

│ │

├─────────────────────────╯

│

◇ Default model #第二项回车

│ Enter model manually // [关键操作]:此处必须回车选择“手动输入”,才会弹出输入框

│

◇ Default model # 弹出vllm/ollama/gpt-oss:20b改为

│ ollama/gpt-oss:20b // [最终确认]:在弹出的输入框内,再次输入上述模型全称进行绑定

三、 快捷指令与 Web UI 配置

1. 快捷 CLI 命令

OpenClaw 的后端逻辑通常将 apiKey 设为必填参数。即使 Ollama 在本地运行时默认不需要 API 密钥(验证为空),如果配置文件中该字段缺失,程序可能会抛出“Missing API Key”的错误或拒绝初始化。程序一个“交代”,告诉 OpenClaw:“我已经提供密钥了”,从而通过启动校验。

直接在终端输入以下命令,可以快速为 Ollama 供应商设置 API Key 占位符:

openclaw config set models.providers.ollama.apiKey "ollama-local"输出结果如下:

🦞 OpenClaw 2026.3.7 (42a1394) — Your .zshrc wishes it could do what I do.

Config overwrite: C:\Users\WIN26H11\.openclaw\openclaw.json (sha256 3383f4360ff3c77c63036b0f77b0ac81ff92aaaab6e12e98b123d33179e09c7f -> def9230ec1512dcfc63f07fcd1a07f6197fd19e0374b999bb89d4270ec365e7b, backup=C:\Users\WIN26H11\.openclaw\openclaw.json.bak)

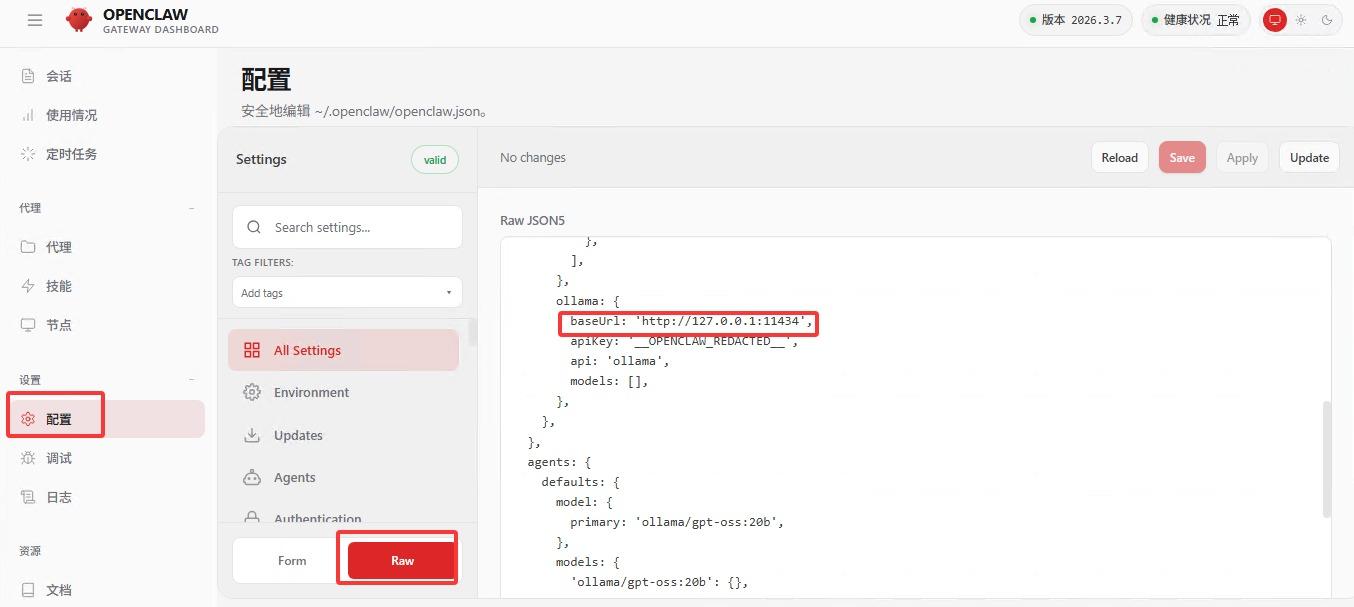

Updated models.providers.ollama.apiKey. Restart the gateway to apply.2. Web UI Raw 模式修改

进入 设置 → 配置。点击界面右下角的 Raw,进入 Raw JSON5 自定义代码界面,找到 baseUrl 配置项,将默认地址改为 Ollama 的实际 IP:

// 将默认的:

baseUrl: 'http://127.0.0.1:11434',

// 修改为实际地址:

baseUrl: 'http://192.168.1.59:11434',

3.点击 Save 保存即可生效。

四、 常见避坑指南(必看)

- API Key 必填: OpenClaw 的后端逻辑通常将

apiKey设为必填项。即使本地 Ollama 不需要验证,也必须填写(如ollama-local)给程序一个“交代”,否则会校验报错。 - 跨设备访问: 若 OpenClaw 与 Ollama 不在同一台电脑,需在 Ollama 运行的机器上设置环境变量

OLLAMA_HOST=0.0.0.0并重启服务,否则连接会被拒绝。 - 网络检查: 确保 OpenClaw 所在机器可以 ping 通 Ollama 机器的 IP,且防火墙已放行

11434端口。 - ollama开放11434参考本站文章:http://www.kaixinit.com/agent/12012.html

原创文章,作者:开心电脑网,如若转载,请注明出处。